Пусть Omega\Omega - множество элементов, которые называются элементарными исходами или элементарными событиями. Непустой класс A\mathcal{A} подмножеств из Omega\Omega, замкнутый относительно операции дополнения и операций объединения конечного и счетного числа своих подмножеств, называется sigma\sigma-алгеброй на Omega\Omega, а сами подмножества - событиями. Приведенные ниже два тождества

(nnn_(j in I)A_(j))^(C)=uuu_(j in I)A_(j)^(C)" и "(uuu_(j in I)A_(j))^(C)=nnn_(j in I)A_(j)^(C),\left(\bigcap_{j \in I} A_{j}\right)^{C}=\bigcup_{j \in I} A_{j}^{C} \text { и }\left(\bigcup_{j \in I} A_{j}\right)^{C}=\bigcap_{j \in I} A_{j}^{C},

в которых буква II обозначает произвольное множество индексов, называются формулами двойственности. Используя первое тождество, можно показать, что sigma\sigma-алгебра замкнута также относительно конечных и счетных пересечений. Если AA - событие, то его дополнение A^(C)A^{C} также является событием. Поэтому все множество Omega=A uuA^(C)\Omega=A \cup A^{C}, а также пустое подмножество O/=A nnA^(C)\emptyset=A \cap A^{C} также являются событиями. Они называются достоверным и невозможным событиями соответственно. Легко убедиться непосредственной проверкой, что

минимальная sigma\sigma-алгебра, содержащая событие AA, состоит из четырех подмножеств {O/,A,A^(C),Omega}\left\{\varnothing, A, A^{C}, \Omega\right\}. В качестве другого очевидного примера sigma\sigma-алгебры можно указать множество всех подмножеств Omega\Omega. Обычно именно такие sigma\sigma-алгебры используются в тех случаях, когда множество Omega\Omega является конечным или счетным. Пару, состоящую из множества Omega\Omega элементарных исходов и sigma\sigma-алгебры A\mathcal{A} его подмножеств, принято называть измеримым пространством (Omega,A)(\Omega, \mathcal{A}).

Пусть KK - произвольное множество индексов, (B_(k))_(k in K)\left(B_{k}\right)_{k \in K} - непустое семейство подмножеств из Omega\Omega, а A(B_(k),k in K)\mathcal{A}\left(B_{k}, k \in K\right) - пересечение всех sigma\sigma-алгебр, содержащих это семейство. Одной из таких sigma\sigma-алгебр является sigma\sigma-алгебра всех подмножеств Omega\Omega. Очевидно, что (B_(k))_(k in K)\left(B_{k}\right)_{k \in K} принадлежит этому пересечению, которое также является sigma\sigma-алгеброй. Эта sigma\sigma-алгебра называется sigma\sigma-алгеброй, порожденной семейством (B_(k))_(k in K)\left(B_{k}\right)_{k \in K}, и является наименьшей sigma\sigma-алгеброй, содержащей это семейство. В частности, приведенная выше sigma\sigma-алгебра {O/,A,A^(C),Omega}\left\{\varnothing, A, A^{C}, \Omega\right\} является наименьшей sigma\sigma-алгеброй A(A)\mathcal{A}(A), порожденной подмножеством A in OmegaA \in \Omega.

Пример sigma\sigma-алгебры ...

Далее будет часто использоваться sigma\sigma-алгебра, порожденная всеми интервалами вещественной прямой RR. Она называется борелевской sigma\sigma-алгеброй и обозначается символом B.sigma\mathcal{B} . \sigma-Алгебра, порожденная vv-мерными интервалами из R^(v)R^{\boldsymbol{v}}, которые называются также гиперинтервалами или гиперпараллелепипедами, также называется борелевской и обозначается символом B^(v)\mathcal{B}^{v}. Ниже приводятся примеры подмножеств sigma\sigma-алгебры B\mathcal{B}, которые называются борелевскими множествами на прямой RR.

(1.1.1) Каждая точка aa прямой RR является борелевским подмножеством, состоящим из одного элемента. Это следует из того, что любая точка a in Ra \in R есть счетное пересечение открытых интервалов

открытых интервалов, которые являются борелевскими подмножествами.

(1.1.2) Множество QQ точек с рациональными координатами является борелевским, так как оно есть объединение счетного числа таких точек.

(1.1.3) Множество иррациональных точек является борелевским, так как оно есть дополнение Q^(c)=R\\QQ^{c}=R \backslash Q множества рациональных чисел.

(1.1.4) Любое открытое множество на RR является борелевским, так как оно есть объединение конечного или счетного числа попарно пересекающихся своих открытых интервалов.

(1.1.5) Замкнутое множество является борелевским, так как оно есть дополнение открытого множества.

(1.1.6) Если отображение f:[0,1]rarr Rf:[0,1] \rightarrow R - непрерывно, то при любом c in Rc \in R множество {x in[0,1]:f(x) <= c}\{x \in[0,1]: f(x) \leq c\} является замкнутым, а значит борелевским.

Вероятностью на sigma\sigma-алгебре A\mathcal{A} называется отображение P:Ararr RP: \mathcal{A} \rightarrow R, удовлетворяющее трем аксиомам. Во-первых, отображение PP является неотрицательным: P(A) >= 0P(A) \geq 0 для любого A inAA \in \mathcal{A}. Во-вторых, отображение PP является нормированным: P(Omega)=1P(\Omega)=1. Наконец, отображение PP является счетно-аддитивным отображением. Последнее свойство означает, что для любого конечного или счетного семейства (A_(k))_(k in K)\left(A_{k}\right)_{k \in K} попарно непересекающихся подмножеств из A\mathcal{A} имеет место равенство

P(sum_(k in K)A_(k))=sum_(k in K)P(A_(k)).P\left(\sum_{k \in K} A_{k}\right)=\sum_{k \in K} P\left(A_{k}\right) .

Совокупность, состоящая из множества элементарных исходов Omega,sigma\Omega, \sigma-алгебры событий A\mathcal{A} и вероятности PP на A\mathcal{A}, называется вероятностным пространством и обозначается ( Omega,A,P\Omega, \mathcal{A}, P ).

(1.1.7) Вероятностное пространство с конечным множеством элементарных исходов. Далее для обозначения количества элементов конечного множества Omega\Omega будет использоваться символ |Omega||\Omega|. Если |Omega| < +oo|\Omega|<+\infty, то в качестве sigma\sigma-алгебры A\mathcal{A} обычно используют множество всех подмножеств Omega\Omega. Всегда можно поставить в соответствие каждому элементарному исходу omega in Omega\omega \in \Omega неотрицательное число P({omega}) >= 0P(\{\omega\}) \geq 0 такое, что

sum_(omega in Omega)P({omega})=1\sum_{\omega \in \Omega} P(\{\omega\})=1

В самом деле, пусть n=|Omega|n=|\Omega|. Перенумеруем элементы Omega\Omega, выберем в интервале ]0,1[:}] 0,1\left[\right. точки (x_(j))_(1 <= j <= n-1)\left(x_{j}\right)_{1 \leq j \leq n-1} таким образом, чтобы x_(1) <= x_(2) <= cdots <= x_(n-1)x_{1} \leq x_{2} \leq \cdots \leq x_{n-1} и определим nn чисел (p_(j))_(1 <= j <= n)\left(p_{j}\right)_{1 \leq j \leq n} следующим образом

Нетрудно убедиться в том, что p_(1)+,,,+p_(n)=1p_{1}+,,,+p_{n}=1.

Для любого подмножества B sub OmegaB \subset \Omega, которое по определению является событием из A\mathcal{A}, определим число P(B)P(B) равенством

P(B)=sum_(omega in B)P({omega}).P(B)=\sum_{\omega \in B} P(\{\omega\}) .

Легко показать, что для так определенного отображения P:Ararr RP: \mathcal{A} \rightarrow R выполняются все аксиомы, то есть PP является вероятностью на A\mathcal{A}.

Пусть PP - вероятность на A\mathcal{A} и D inAD \in \mathcal{A}. Легко убедиться в том, что семейство A_(D)\mathcal{A}_{D}, состоящее из всех пересечений вида A nn DA \cap D, гле A inAA \in \mathcal{A}, будет sigma\sigma-алгеброй подмножеств из DD. При P(D) > 0P(D)>0 отображение P_(D):A_(D)rarr RP_{D}: \mathcal{A}_{D} \rightarrow R, определяемое для любого A nn D inA_(D)A \cap D \in \mathcal{A}_{D} равенством

P_(D)(A nn D)=(P(A nn D))/(P(D)),P_{D}(A \cap D)=\frac{P(A \cap D)}{P(D)},

будет вероятностью на A_(D)\mathcal{A}_{D}. Таким образом, совокупность ( D,A_(D),P_(D)D, \mathcal{A}_{D}, P_{D} ) является вероятностным пространством. При этом каждое событие A nn DA \cap D из A_(D)\mathcal{A}_{D} является событием в A\mathcal{A}. Поэтому вероятностное пространство ( D,A_(D),P_(D)D, \mathcal{A}_{D}, P_{D} ) называется подпространством пространства ( Omega,A,P\Omega, \mathcal{A}, P ).

Так как каждое подмножество B=A nn DB=A \cap D из A_(D)\mathcal{A}_{D} является подмножеством sigma\sigma-алгебры A\mathcal{A} и одновременно B sub DB \subset D, то вероятность P_(D)(B)P_{D}(B) можно записать следующим образом:

P_(D)(B)=(P(B))/(P(D))=(P(A nn D))/(P(D))=P(A∣D).P_{D}(B)=\frac{P(B)}{P(D)}=\frac{P(A \cap D)}{P(D)}=P(A \mid D) .

Задачи

Пусть XX - непустое множество, (A_(j))_(j in J)\left(A_{j}\right)_{j \in J} - произвольное семейство его подмножеств. Непосредственной проверкой убедиться в справедливости тождеств

(uuu_(j in J)A_(j))^(C)=nnn_(j in J)A_(j)^(C)" и "(nnn_(j in J)A_(j))^(C)=uuu_(j in J)A_(j)^(C),\left(\bigcup_{j \in J} A_{j}\right)^{C}=\bigcap_{j \in J} A_{j}^{C} \text { и }\left(\bigcap_{j \in J} A_{j}\right)^{C}=\bigcup_{j \in J} A_{j}^{C},

известных под именем формул двойственности.

2. Пусть XX и YY - непустые множества, ff - отображение вида X rarr YX \rightarrow Y, а Theta\Theta - множество, элементы которого называются индексами. Показать, что при любом B sub YB \subset Y и B_(theta)sub Y,theta in ThetaB_{\theta} \subset Y, \theta \in \Theta, справедливы тождества

{:[f^(-1)(B^(C))=(f^(-1)(B))^(C)","quadf^(-1)(uuu_(theta in Theta)B_(theta))=uuu_(theta in Theta)f^(-1)(B_(theta))],[f^(-1)(nnn_(theta in Theta)B_(theta))=nnn_(theta in Theta)f^(-1)(B_(theta))]:}\begin{gathered}

f^{-1}\left(B^{C}\right)=\left(f^{-1}(B)\right)^{C}, \quad f^{-1}\left(\bigcup_{\theta \in \Theta} B_{\theta}\right)=\bigcup_{\theta \in \Theta} f^{-1}\left(B_{\theta}\right) \\

f^{-1}\left(\bigcap_{\theta \in \Theta} B_{\theta}\right)=\bigcap_{\theta \in \Theta} f^{-1}\left(B_{\theta}\right)

\end{gathered}

Доказать, что sigma\sigma-алгебра, порожденная интервалами вида ]-oo,x],x in R]-\infty, x], x \in R, вещественной прямой RR, является борелевской.

Привести пример вероятностного пространства с конечным множеством Omega\Omega элементарных событий.

Привести пример вероятностного пространства со счетным множеством Omega\Omega элементарных событий.

Привести пример вероятностного пространства с множеством элементарных событий Omega=[0;1]xx[0;1]\Omega=[0 ; 1] \times[0 ; 1].

1.2 Случайные величины и их распределения

Операция взятия прообраза и ее свойства. Скалярные и векторные случайные величины. Примеры случайных величин. Свойства распределения векторных случайных величин. Дискретные случайные величины. Плотность распределения. Примеры. Числовые характеристики случайных величин.

Пусть (Omega,A)(\Omega, \mathcal{A}) - измеримом пространство, B\mathcal{B} - борелевская sigma\sigma - алгебра на RR. Отображение вида xi:Omega rarr R\xi: \Omega \rightarrow R называется скалярной случайной величиной, определенной на ( Omega,A\Omega, \mathcal{A} ), если для любого борелевского множества B inBB \in \mathcal{B} его прообраз

{:xi^(-1)(B)={omega in Omega:xi(omega)in B)}\left.\xi^{-1}(B)=\{\omega \in \Omega: \xi(\omega) \in B)\right\}

является событием из A\mathcal{A}.

(1.2.1) Множество C\mathcal{C} всех подмножеств BB из RR, прообразы xi^(-1)(B)\xi^{-1}(B) которых являются событиями, есть sigma\sigma-алгебра.

Доказательство. В соответствии с определением sigma\sigma-алгебры требуется показать, во-первых, что для любого B inCB \in \mathcal{C} его дополнение B^(C)inCB^{C} \in \mathcal{C}. Это утверждение следует из тождества

В самом деле, пусть B inCB \in \mathcal{C}. Тогда xi^(-1)(B)\xi^{-1}(B) принадлежит sigma\sigma - алгебре A\mathcal{A}, которая содержит также и его дополнением (xi^(-1)(B))^(C)\left(\xi^{-1}(B)\right)^{C}. Следовательно, B^(C)B^{C} также принадлежит C\mathcal{C}. Во-вторых, требуется показать, что для любого конечное или счетного семейства (B_(j))_(j >= 1)\left(B_{j}\right)_{j \geq 1} подмножеств из C\mathcal{C} их объединение также принадлежит C\mathcal{C}. Это следует из тождества

По определению случайной величины прообраз любого интервала является событием из A\mathcal{A}. Поэтому sigma\sigma-алгебра C\mathcal{C} содержит все интервалы из RR, а также содержит sigma\sigma-алгебру B\mathcal{B}, порожденную интервалами (борелевскую).

называется vv-мерной (или векторной) случайной величиной, определенным на измеримом пространстве ( Omega,A\Omega, \mathcal{A} ), если для любого борелевского множества B inB^(v)B \in \mathcal{B}^{v} его прообраз

xi^(-1)(B)={omega in Omega:xi(omega)in B}\xi^{-1}(B)=\{\omega \in \Omega: \xi(\omega) \in B\}

является событием из A\mathcal{A}.

Ниже перечисляются свойства случайных величин, которые будут использоваться далее. Их доказательства приводятся в курсах по теории вероятностей.

(1.2.2) Пусть (A_(k))_(k >= 1)\left(A_{k}\right)_{k \geq 1} - счетное семейство попарно непересекающихся событий sigma\sigma-алгебры A\mathcal{A}, объединение которых совпадает с Omega\Omega, и пусть (x_(k))_(k >= 1)\left(x_{k}\right)_{k \geq 1} счетное семейство из RR. Тогда отображение xi:Omega rarr R\xi: \Omega \rightarrow R, определяемое равенством

будет случайной величиной на измеримом пространстве ( Omega,A\Omega, \mathcal{A} ).

(1.2.3) Каждое непрерывное отображение вида xi:R^(v)rarr R\xi: R^{v} \rightarrow R является случайной величиной на измеримом пространстве ( R^(v),B^(v)R^{v}, \mathcal{B}^{v} ).

(1.2.4) Множество случайных величин замкнуто относительно основных операций анализа: сложения, вычитания, умножения, деления при отличном от нуля делителя и предельного перехода).

(1.2.5) Пусть vv - некоторое натуральное число и (xi^((k)))_(1 <= k <= v)\left(\xi^{(k)}\right)_{1 \leq k \leq v} - набор отображений вида Omega rarr R\Omega \rightarrow R. Для того, чтобы векторное отображение xi:Omega rarrR^(v)\xi: \Omega \rightarrow R^{v}, определяемое равенством

было векторной случайной величиной необходимо и достаточно, чтобы каждое отображение xi^((k)),1 <= k <= v\xi^{(k)}, 1 \leq k \leq v, было скалярной случайной величиной.

Пусть ( Omega,A,P\Omega, \mathcal{A}, P ) - вероятностное пространство, B^(v)\mathcal{B}^{v} - борелевская sigma\sigma-алгебра на R^(v)R^{v}. Каждая случайная величина xi:Omega rarrR^(v)\xi: \Omega \rightarrow R^{v} определяет на борелевской sigma\sigma-алгебре B^(v)\mathcal{B}^{v} отображение P_(xi):B^(v)rarr RP_{\xi}: \mathcal{B}^{v} \rightarrow R при помощи равенства

P_(xi)(B)=P(xi^(-1)(B))=P(omega in Omega:xi(omega)in B),B inB^(v)P_{\xi}(B)=P\left(\xi^{-1}(B)\right)=P(\omega \in \Omega: \xi(\omega) \in B), B \in \mathcal{B}^{v}

которое является вероятностью на ( R^(v),B^(v)R^{v}, \mathcal{B}^{v} ). Из определения P_(xi)P_{\xi} следует, что P_(xi)(B) >= 0P_{\xi}(B) \geq 0 для любого B inB^(v)B \in \mathcal{B}^{v}. Справедливость аксиомы P_(xi)(R^(v))=1P_{\xi}\left(R^{v}\right)=1 вытекает из очевидного равенства

xi^(-1)(R^(v))={omega in Omega:xi(omega)inR^(v)}=Omega.\xi^{-1}\left(R^{v}\right)=\left\{\omega \in \Omega: \xi(\omega) \in R^{v}\right\}=\Omega .

Вероятность P_(xi)P_{\xi} на борелевской sigma\sigma-алгебре B^(v)B^{v} называется распределением вероятностей или просто распределением случайной величины xi\xi.

Отображение f:R^(v)rarr Rf: R^{v} \rightarrow R называется измеримым по Борелю или борелевским, если для любого борелевского множества B inB^(v)B \in \mathcal{B}^{v} множество

является случайной величиной на ( Omega,A\Omega, \mathcal{A} ).

Доказательство. Для любого борелевского подмножества B inB^(v)B \in \mathcal{B}^{v} получаем

{:[eta^(-1)(B)={omega in Omega:eta(omega)in B}={omega in Omega:f(xi(omega))in B}=],[{omega in Omega:xi(omega)inf^(-1)(B)}=xi^(-1)(f^(-1)(B).:}]:}\begin{gathered}

\eta^{-1}(B)=\{\omega \in \Omega: \eta(\omega) \in B\}=\{\omega \in \Omega: f(\xi(\omega)) \in B\}= \\

\left\{\omega \in \Omega: \xi(\omega) \in f^{-1}(B)\right\}=\xi^{-1}\left(f^{-1}(B) .\right.

\end{gathered}

Так как ff борелевское отображение, то f^(-1)(B)f^{-1}(B) борелевское множество. xi\xi -

случайная величина, поэтому прообраз xi^(-1)(f^(-1)(B))\xi^{-1}\left(f^{-1}(B)\right) борелевского множества f^(-1)(B)f^{-1}(B) является событием из A\mathcal{A}. Что и требовалось доказать.

Определенное выше отображение eta\eta называется обычно суперпозицией отображений ff и xi\xi и обозначается f@xif \circ \xi или f(xi)f(\xi).

Векторная ( vv-мерная) случайная величина xi\xi называется дискретной, если существует не более, чем счетное подмножество Q_(xi)subR^(v)Q_{\xi} \subset R^{v}, такое, что P_(xi)({x}) > 0P_{\xi}(\{x\})>0 для любого x inQ_(xi)x \in Q_{\xi} и что P_(xi)(Q_(xi))=1P_{\xi}\left(Q_{\xi}\right)=1. Подмножество Q_(xi)Q_{\xi} является борелевским и называется множеством значений случайной величины xi\xi. Из равенства

следует, что P_(xi)(Q_(xi)^(C))=0P_{\xi}\left(Q_{\xi}^{C}\right)=0. Поэтому P_(xi)({x})=0P_{\xi}(\{x\})=0 для каждого x inQ_(xi)^(C)x \in Q_{\xi}^{C}. Более того, для любого B inB^(v)B \in \mathcal{B}^{v} справедливо равенство

P_(xi)(B)=sum_(x in B nnQ_(xi))P_(xi)({x}).P_{\xi}(B)=\sum_{x \in B \cap Q_{\xi}} P_{\xi}(\{x\}) .

Пусть xi\xi - mu\mu-мерная, eta-v\eta-v - мерная дискретные случайные величины, принимающие значения в конечных подмножествах Q_(mu)Q_{\mu} и Q_(v)Q_{v} - конечные подмножества в R^(mu)R^{\mu} и R^(v)R^{v} соответственно, а xi-(mu+v)\xi-(\mu+v) - мерная дискретная случайная величина со значениями в множестве Q_(mu)xxQ_(nu)Q_{\mu} \times Q_{\nu} из R^(mu+nu)R^{\mu+\nu}. Тогда

Пусть xi\xi - векторная ( vv-мерная) случайная величина, а P_(xi)P_{\xi} - ее распределение. Неотрицательная измеримая по Борелю функция p_(xi):R^(v)rarr Rp_{\xi}: R^{v} \rightarrow R называется плотностью распределения P_(xi)P_{\xi} случайной величины xi\xi, если для любого борелевского множества B inB^(v)B \in B^{v} имеет место равенство

P_(xi)(B)=int_(B)p_(xi)(x)dxP_{\xi}(B)=\int_{B} p_{\xi}(x) d x

В курсах теории вероятностей доказывается, что для каждого неотрицательного отображения вида p:R^(v)rarr Rp: R^{v} \rightarrow R такого, что

int_(R^(v))p(x)dx=1\int_{R^{v}} p(x) d x=1

существует случайная величина xi\xi, для которой pp является плотностью вероятностей.

Отображение вида

p(x)={[0","x < a],[(x)/(b-a)],[0","b < x],a <= x <= b,:}p(x)=\left\{\begin{array}{l}

0, x<a \\

\frac{x}{b-a} \\

0, b<x

\end{array}, a \leq x \leq b,\right.

является плотностью распределения, которое называется равномерным распределением на интервале [a,b][a, b].

Пусть Y={y_(1),dots,y_(|Y|)}Y=\left\{y_{1}, \ldots, y_{|Y|}\right\} - конечное множество вещественных чисел, в частности Y={0,dots,|Y|-1}Y=\{0, \ldots,|Y|-1\}. Семейство

p(y)=(1)/(|Y|),quad y in Yp(y)=\frac{1}{|Y|}, \quad y \in Y

неотрицательных чисел является распределением дискретной случайной величины, которое называется равномерным распределением на множестве YY.

При решении прикладных задач для описания свойств векторной случайной величины xi_(A)=(xi_(a))_(a in A)\xi_{A}=\left(\xi_{a}\right)_{a \in A} довольно часто вместо |A||A|-мерного распределения P_(Y)^(A)P_{Y}{ }^{A} используют числовые характеристики случайных величин.

Основной числовой характеристикой случайной величины является число, называемое ее средним значением или математическим ожиданием. Пусть P_(xi)=(p_(xi)(x))_(x in Y)P_{\xi}=\left(p_{\xi}(x)\right)_{x \in Y} - распределение дискретной скалярной случайной величины xi\xi со значениями в YY, а p_(eta)p_{\eta} - плотность распределения случайной величины eta\eta. Тогда их средние значения определяются равенствами

E xi=sum_(x_(z)in Y)xp_(xi)(x)" и "E eta=int_(R^(v))xp_(eta)(x)dxE \xi=\sum_{x_{z} \in Y} x p_{\xi}(x) \text { и } E \eta=\int_{R^{v}} x p_{\eta}(x) d xи

Ниже перечислены свойства среднего значения, которые будут использоваться далее. Если c-c- константа, то E(c)=c,E(c xi)=cE xiE(c)=c, E(c \xi)=c E \xi,

E(xi+eta)=E xi+E etaE(\xi+\eta)=E \xi+E \eta

Если xi\xi и eta\eta независимы, то

E(xi eta)=E xi E etaE(\xi \eta)=E \xi E \eta

Пусть xi\xi и eta\eta - случайные величины, тогда при любом вещественном xx выполняется неравенство

и следующего из него неравенство 4(E|xi eta|)^(2)-4Exi^(2)Eeta^(2) <= 04(E|\xi \eta|)^{2}-4 E \xi^{2} E \eta^{2} \leq 0. Последнее неравенство, представленное в форме

получило название неравенства Буняковского- Коши-Шварца и буде использоваться далее.

Еще одной числовой характеристикой случайной величины xi\xi со средним значением E xiE \xi является число D xiD \xi, определяемое равенством

D xi=E(xi-E xi)^(2)D \xi=E(\xi-E \xi)^{2}

Оно называется дисперсией xi\xi. Из определения дисперсии немедленно следует, что D xi >= 0,D xi=E(xi)^(2)-(E xi)^(2)D \xi \geq 0, D \xi=E(\xi)^{2}-(E \xi)^{2} и D(c xi)=c^(2)D xiD(c \xi)=c^{2} D \xi. Кроме того, если xi\xi и eta\eta независимы, то

D(xi+eta)=D xi+D etaD(\xi+\eta)=D \xi+D \eta

Квадратный корень из дисперсии D xiD \xi называется среднеквадратическим отклонением или стандартом случайной величины xi\xi и обозначается буквой sigma_(xi)\sigma_{\xi} или просто sigma\sigma, когда это не приводит к неопределенности. Следовательно, sigma_(xi)^(2)=D xi\sigma_{\xi}^{2}=D \xi.

Приведенное ниже неравенство

P(|eta-m_(eta)| >= ksigma_(eta)) <= (1)/(k^(2))P\left(\left|\eta-m_{\eta}\right| \geq k \sigma_{\eta}\right) \leq \frac{1}{k^{2}}

называется неравенством Чебышева. Оно позволяет оценить величину рассеивания (разброса) значений случайной величины относительно ее среднего значения в единицах стандартного отклонения sigma_(eta)\sigma_{\eta}.

Ковариацией случайных величин xi_(z)\xi_{z} и xi_(t)\xi_{t} со средними значениями m_(z)m_{z} и m_(t)m_{t} соответственно называется число cov(xi_(z),xi_(t))\operatorname{cov}\left(\xi_{z}, \xi_{t}\right), определяемое равенством

cov(xi_(z),xi_(z))=sigma_(z)^(2)" и "cov(xi_(z),xi_(t))=cov(xi_(t),xi_(z)).\operatorname{cov}\left(\xi_{z}, \xi_{z}\right)=\sigma_{z}^{2} \text { и } \operatorname{cov}\left(\xi_{z}, \xi_{t}\right)=\operatorname{cov}\left(\xi_{t}, \xi_{z}\right) .и

Если xi_(z)\xi_{z} и xi_(t)\xi_{t} независимы, то из свойства E(xi_(z)xi_(t))=Exi_(z)Exi_(t)E\left(\xi_{z} \xi_{t}\right)=E \xi_{z} E \xi_{t} средних значений следует, что cov(xi_(z),xi_(t))=0\operatorname{cov}\left(\xi_{z}, \xi_{t}\right)=0. Обратное утверждение справедливо только для случайных величин с нормальными распределениями.

Нормированным коэффициентом корреляции двух случайных величин xi_(z)\xi_{z} и xi_(t)\xi_{t} называется число R(xi_(z),xi_(t))R\left(\xi_{z}, \xi_{t}\right), определяемое равенством

С помощью неравенства Буняковского-Коши-Шварца, легко убедиться в том, что |R(xi_(z),xi_(t))| <= 1\left|R\left(\xi_{z}, \xi_{t}\right)\right| \leq 1. Если xi_(z)\xi_{z} и xi_(t)\xi_{t} - независимы, то из выше сказанного следует, что R(xi_(z),xi_(t))=0R\left(\xi_{z}, \xi_{t}\right)=0. С другой стороны, пусть xi\xi - случайная величина со средним E xi=mE \xi=m и дисперсией D xi=sigma^(2)D \xi=\sigma^{2}. Пусть c!=0c \neq 0 и dd - вещественные числа и eta=cxi+d\eta=\mathrm{c} \xi+d - случайная величина со средним E eta=cm+dE \eta=c m+d и дисперсией D eta=c^(2)sigma^(2)D \eta=c^{2} \sigma^{2}. Тогда

Таким образом, R(xi,eta)=1R(\xi, \eta)=1 при c > 1c>1 и R(xi,eta)=-1R(\xi, \eta)=-1 при c < 1c<1. Перечисленные свойства коэффициента корреляции позволяют использовать его в качестве меры зависимости между случайными величинами.

Задачи

Определить случайную величину xi\xi с равномерным распределением на интервале [0,1][0,1] (указать Omega,A,P\Omega, A, P и вид отображения xi:Omega rarr R\xi: \Omega \rightarrow R ).

Определить плотность случайной величины с треугольным распределением...

Определить случайную величину xi=(xi_(1),xi_(2))\xi=\left(\xi_{1}, \xi_{2}\right) с равномерным распределением на квадрате [0,1]xx[0,1][0,1] \times[0,1] (указать Omega,A,P\Omega, A, P и вид отображения xi:Omega rarr R)\xi: \Omega \rightarrow R). Показать, что случайные величины xi_(1)\xi_{1} и xi_(2)\xi_{2} независимы.

Определить случайную величину xi=(xi_(1),xi_(2))\xi=\left(\xi_{1}, \xi_{2}\right) с равномерным распределением на круге B(0,1)={(x_(1),x_(2))inR^(2):x_(1)^(2)+x_(2)^(2) <= 1}B(0,1)=\left\{\left(x_{1}, x_{2}\right) \in R^{2}: x_{1}^{2}+x_{2}^{2} \leq 1\right\} (указать Omega,A,P\Omega, A, P и вид отображения xi:Omega rarr R\xi: \Omega \rightarrow R ). Показать, что xi_(1)\xi_{1} и xi_(2)\xi_{2} зависимы.

1.3. Свойства многомерных случайных величин

Пусть nn - натуральное число и (f_(j))_(1 <= j <= n)\left(f_{j}\right)_{1 \leq j \leq n} - семейство отображений вида R^(n)rarr R\boldsymbol{R}^{n} \rightarrow \boldsymbol{R}. Отображение f:R^(n)rarrR^(n)f: \boldsymbol{R}^{n} \rightarrow \boldsymbol{R}^{n}, определяемое равенством

называется гладким, если все отображения f_(j),1 <= j <= nf_{j}, 1 \leq j \leq n, являются непрерывными и имеют непрерывные частные производные. Пусть ff - гладкое отображение. Для любого x inR^(n)x \in \boldsymbol{R}^{n} существует квадратная матрица

порядка nn, элементами которой являются частные производные, вычисленные в xx. Она называется матрицей Якоби, а ее определитель, обозначаемый символом Df(x)D f(x), - якобианом. Таким образом, каждое гладкое отображение ff определяет на множестве R^(n)\boldsymbol{R}^{n} отображение DfD f вида R^(n)rarr R\boldsymbol{R}^{n} \rightarrow \boldsymbol{R}, ставящее каждому xx значение Df(x)D f(x).

Пусть ff - гладкое отображение вида R^(n)rarrR^(n)\boldsymbol{R}^{n} \rightarrow \boldsymbol{R}^{n}. Если в точке x inR^(n)x \in \boldsymbol{R}^{n} якобиан Df(x)!=0D f(x) \neq 0, то в окрестности точки f(x)f(x) существует гладкое обратное отображение f^(-1)f^{-1} и выполняется равенство

Df(x)Df^(-1)(f(x))=1.D f(x) D f^{-1}(f(x))=1 .

Если гладкое отображение f:R^(v)rarrR^(v)f: \boldsymbol{R}^{v} \rightarrow \boldsymbol{R}^{v} является, кроме того, взаимно однозначным, то имеет место формула замены переменных в определенном интеграле

int_(B)g(x)dx=int_(f^(-1)(B))g(f(x))|Df(x)|dx\int_{B} g(x) d x=\int_{f^{-1}(B)} g(f(x))|D f(x)| d x

В качестве примера применим эту формулу для вычисления плотности случайной величины eta=f(xi)\eta=f(\xi).

(1.3.1) Пусть xi=(xi_(j))_(1 <= j <= n)\xi=\left(\xi_{j}\right)_{1 \leq j \leq n} - случайный вектор, p_(xi):R^(n)rarr Rp_{\xi}: \boldsymbol{R}^{n} \rightarrow \boldsymbol{R} - его плотность, а f:R^(n)rarrR^(n)f: \boldsymbol{R}^{n} \rightarrow \boldsymbol{R}^{n} - гладкое взаимно однозначное отображение. Тогда eta=f(xi)\eta= f(\xi) также является nn-мерной случайной величиной, а ее плотность p_(eta)p_{\eta} определяется равенством вида

Теорема доказана. Из нее следует, в частности, что ковариационная матрица C_(xi)C_{\xi} любой векторной случайной величины xi=(xi_(j))_(1 <= j <= n)\xi=\left(\xi_{j}\right)_{1 \leq j \leq n} является неотрицательно определенной. В самом деле, (C_(xi)x,x)=D(x,xi) >= 0\left(C_{\xi} x, x\right)=D(x, \xi) \geq 0 для любого x inR^(n)x \in \boldsymbol{R}^{n}.

Пусть xi=(xi_(j))_(1 <= j <= n)\xi=\left(\xi_{j}\right)_{1 \leq j \leq n} - векторная случайная величина. Говорят, что ее распределение P_(xi)P_{\xi} сосредоточено на множестве QQ из R^(n)\boldsymbol{R}^{n}, если P_(xi)(Q)=1P_{\xi}(Q)=1.

Пусть q in R,a=(a_(j))_(1 <= j <= n)q \in \boldsymbol{R}, a=\left(a_{j}\right)_{1 \leq j \leq n} - вектор из R^(n)\\{0}\boldsymbol{R}^{n} \backslash\{0\}. Подмножество HH из R^(n)\boldsymbol{R}^{n}, определяемое равенством

называется гиперплоскостью.

(1.3.4) Пусть xi=(xi_(j))_(1 <= j <= n)\xi=\left(\xi_{j}\right)_{1 \leq j \leq n} - векторная случайная величина. Для того, чтобы ее распределение P_(xi)P_{\xi} было сосредоточено на некоторой гиперплоскости H subR^(n)H \subset \boldsymbol{R}^{n} необходимо и достаточно, чтобы ковариационная матрица C_(xi)C_{\xi} была вырожденной.

Доказательство необходимости. Пусть HH - гиперплоскость, на которой сосредоточено распределение P_(xi)P_{\xi}. Тогда из P_(xi)(H)=1P_{\xi}(H)=1 следует, что

P(xi^(-1)(H))=P{omega in Omega:xi(omega)in H}=P{omega in Omega:(a,xi(omega))=q}=1.P\left(\xi^{-1}(H)\right)=P\{\omega \in \Omega: \xi(\omega) \in H\}=P\{\omega \in \Omega:(a, \xi(\omega))=q\}=1 .

Следовательно, скалярная случайная величина (a,xi)(a, \xi) принимает с вероятностью равной единице значение qq. Это означает, что ее дисперсия D(a,xi)=0D(a, \xi)=0. Из (1.3.2) следует, что (C_(xi)a,a)=0\left(C_{\xi} a, a\right)=0 при a inR^(n)\\{0}a \in \boldsymbol{R}^{n} \backslash\{0\}. Если квадратичная форма обращается в ноль при ненулевом векторе a inR^(n)\\{0}a \in \boldsymbol{R}^{n} \backslash\{0\}, то ее матрица C_(xi)C_{\xi} называется вырожденной.

Достаточность. Пусть ковариационная матрица C_(xi)C_{\xi} - вырождена. Тогда существует такое a inR^(n)\\{0}a \in R^{n} \backslash\{0\}, что (C_(xi)a,a)=0\left(C_{\xi} a, a\right)=0. Из (2.3.2) следует, что дисперсия D(a,xi)=0D(a, \xi)=0. Это означает, что существует q in Rq \in \boldsymbol{R} такое, что вероятность равенства (a,xi)=q(a, \xi)=q равна единице. То есть

P{omega in Omega:(a,xi(omega))=q}=P({omega in Omega:xi(omega)in H}=P(xi^(-1)(H))=P_(xi)(H)=1.:}P\{\omega \in \Omega:(a, \xi(\omega))=q\}=P\left(\{\omega \in \Omega: \xi(\omega) \in H\}=P\left(\xi^{-1}(H)\right)=P_{\xi}(H)=1 .\right.

Теорема доказана.

(1.3.5) Пусть xi=(xi_(j))_(1 <= j <= n)-n\xi=\left(\xi_{j}\right)_{1 \leq j \leq n}-n-мерная случайная величина, C_(xi)-C_{\xi}- ее матрица ковариаций, a=(a_(j))_(1 <= j <= m)a=\left(a_{j}\right)_{1 \leq j \leq m} - вектор из R^(m)\boldsymbol{R}^{m} и A=(a_(ij))_(1 <= i <= m,1 <= j <= n)A=\left(a_{i j}\right)_{1 \leq i \leq m, 1 \leq j \leq n} матрица размерности m xx nm \times n. Тогда eta=A xi+a\eta=A \xi+a является mm-мерной случайной величиной с матрицей ковариации

C_(eta)=AC_(xi)A^(t).C_{\eta}=A C_{\xi} A^{t} .

Доказательство. Для любого i,1 <= i <= mi, 1 \leq i \leq m, отображение f_(i):R^(n)rarr Rf_{i}: \boldsymbol{R}^{n} \rightarrow \boldsymbol{R}, определяемое равенством

является непрерывной функцией. Поэтому eta_(i)=f_(i)(xi)\eta_{i}=f_{i}(\xi) - скалярная случайная величина, а eta=A xi+a\eta=A \xi+a - векторная. Используя (2.3.2), для каждого x inR^(n)x \in \boldsymbol{R}^{n} получаем

D(x,eta)=D(x,A xi+a)=0+D(x,A xi)=D(x,A xi).D(x, \eta)=D(x, A \xi+a)=0+D(x, A \xi)=D(x, A \xi) .

Из непосредственно проверяемого тождества (x,Ay)=(A^(t)x,y)(x, A y)=\left(A^{t} x, y\right), где xx и yy векторы из R^(n)\boldsymbol{R}^{n}, а AA - квадратная матрица порядка nn, следует, что

С другой стороны, на основании (2.3.2) имеем равенство D(x,eta)=(C_(eta)x,x)D(x, \eta)=\left(C_{\eta} x, x\right), из которого следует утверждение теоремы.

Задачи

Пусть xx и yy векторы из R^(n)\boldsymbol{R}^{n}, а AA - квадратная матрица порядка nn. Доказать тождество (x,Ay)=(A^(t)x,y)(x, A y)=\left(A^{t} x, y\right).

1.4. Многомерное нормальное распределение

Говорят, что одномерная случайная величина xi\xi имеет стандартное одномерное нормальное распределение, если его плотность p_(xi)p_{\xi} определяется равенCTBOM

Непосредственным вычислением можно убедиться в том, что ее среднее значение E xi=0E \xi=0, а дисперсия D xi=1D \xi=1. Если eta=sigma xi+a\eta=\sigma \xi+a, то E eta=aE \eta=a и D eta=sigma^(2)D \eta=\sigma^{2}. Распределение случайной величины eta\eta называется одномерным нормальным распределением с параметрами N(a,sigma)N(a, \sigma). Из (1.3.2) следует, что плотность ее распределения имеет вид

Распределение nn-мерного случайного вектора xi=(xi_(j))_(1 <= j <= n)\boldsymbol{\xi}=\left(\xi_{j}\right)_{1 \leq j \leq n} с независимыми компонентами принято называть nn-мерным стандартным нормальным распределением, если каждая одномерная компонента имеет стандартное нормальное распределение с параметрами N(0,1)N(0,1). В этом случае

а матрица ковариаций C_(xi)=EC_{\xi}=E. В самом деле, если i!=ji \neq j, то cov(xi_(i),xi_(j))=Exi_(i)Exi_(j)=0\operatorname{cov}\left(\xi_{i}, \xi_{j}\right)= E \xi_{i} E \xi_{j}=0, в остальных случаях cov(xi_(i),xi_(i))=E(xi_(i))^(2)=1\operatorname{cov}\left(\xi_{i}, \xi_{i}\right)=E\left(\xi_{i}\right)^{2}=1.

Пусть AA - квадратная матрица порядка n,xi=(xi_(j))_(1 <= j <= n)n, \boldsymbol{\xi}=\left(\xi_{j}\right)_{1 \leq j \leq n} - случайный вектор со стандартным нормальным распределением и a inR^(n)\boldsymbol{a} \in \boldsymbol{R}^{n}. Распределение случайного вектора eta=(eta_(j))_(1 <= j <= n)\boldsymbol{\eta}=\left(\eta_{j}\right)_{1 \leq j \leq n}, определяемого равенством eta=A xi+a\boldsymbol{\eta}=A \boldsymbol{\xi}+\boldsymbol{a}, называется nn-мерным нормальным распределением. Так как

то Eeta_(j)=a_(j)E \eta_{j}=a_{j}. Так как C_(xi)=EC_{\xi}=E, то из (1.3.5) следует, что C_(eta)=AC_(xi)A^(t)=AA^(t)C_{\eta}=A C_{\xi} A^{t}=A A^{t}.

(1.4.1) Если xi=(xi_(j))_(1 <= j <= n)\boldsymbol{\xi}=\left(\xi_{j}\right)_{1 \leq j \leq n} - случайный вектор со стандартным nn-мерным нормальным распределением, а eta=A xi+a\boldsymbol{\eta}=A \boldsymbol{\xi}+\boldsymbol{a}, то плотность p_(eta)np_{\boldsymbol{\eta}} n-мерного нормального распределения случайного вектора eta\boldsymbol{\eta} имеет вид

Доказательство. Покажем, что отображение f(x)=Ax+af(x)=A x+a вида R^(n)rarrR^(n)\boldsymbol{R}^{n} \rightarrow \boldsymbol{R}^{n} является гладким взаимно однозначным и воспользуемся для вычисления p_(eta)p_{\eta} теоремой (1.3.1). Из нее следует, что

то ff является гладким. Поэтому в каждой точке x inR^(n)x \in R^{n} Якобиан отображения f=(f_(j))_(1 <= j <= n)f=\left(f_{j}\right)_{1 \leq j \leq n} равен Df(x)=det(A)D f(x)=\operatorname{det}(A). При det(A)!=0\operatorname{det}(A) \neq 0 прообраз любого x inR^(n)x \in \boldsymbol{R}^{n}

f^(-1)(x)={t inR^(n):At+a=x}={t inR^(n):t=A^(-1)(x-a)}=A^(-1)(x-a)f^{-1}(x)=\left\{t \in \boldsymbol{R}^{n}: A t+a=x\right\}=\left\{t \in \boldsymbol{R}^{n}: t=A^{-1}(x-a)\right\}=A^{-1}(x-a)

является вектор A^(-1)(x-a)A^{-1}(x-a), то отображение ff является взаимно однозначным. Из Df(x)=det(A)D f(x)=\operatorname{det}(A) и Df(x)Df^(-1)(f(x))=1D f(x) D f^{-1}(f(x))=1 следует, что

С другой стороны, det(C_(eta))=det(A)(detA^(t))=(det(A))^(2)\operatorname{det}\left(C_{\eta}\right)=\operatorname{det}(A)\left(\operatorname{det} A^{t}\right)=(\operatorname{det}(A))^{2}. Поэтому det(A)=sqrt(det(C_(eta)))\operatorname{det}(A)=\sqrt{\operatorname{det}\left(C_{\eta}\right)}. Применяя (2.3.1), получаем

После применения известного тождества {:(x,Ay)=(A^(t)x,y))\left.(x, A y)=\left(A^{t} x, y\right)\right), где xx и yy векторы из R^(n)\boldsymbol{R}^{n}, а AA - квадратная матрица порядка nn, к скалярному произведению из правой части, имеем

Транспонируя равенство AA^(-1)=EA A^{-1}=E, имеем (A^(-1))^(t)A^(t)=E\left(A^{-1}\right)^{t} A^{t}=E. После умножения обеих его частей справа на (A^(t))^(-1)\left(A^{t}\right)^{-1} получаем равенство (A^(-1))^(t)=(A^(t))^(-1)\left(A^{-1}\right)^{t}=\left(A^{t}\right)^{-1}. Поэтому

чем и завершается доказательство.

Таким образом, nn-мерное нормальное распределение случайного вектора eta\eta определяется его вектором aa средних значений и ковариационной матрицей C_(eta)C_{\eta} и кратко обозначается N(a,C_(eta))N\left(a, C_{\eta}\right). Если det(C_(eta))=0\operatorname{det}\left(C_{\eta}\right)=0, то из (2.3.3) следует, что нормальное распределение сосредоточено на гиперплоскости. В этом случае плотность p_(eta)p_{\eta} распределения в R^(n)\boldsymbol{R}^{n} не существует.

Задачи

Пусть xi\xi - случайный вектор с nn-мерным нормальным распределением N(a,C_(xi)),BN\left(a, C_{\xi}\right), B - матрица размерности m xx nm \times n и b inR^(m)b \in R^{m}. Показать, что случайный вектор eta=B xi+b\eta=B \xi+b имеет нормальное mm-мерное распределение с параметрами N(Ba+b,C_(xi)BC_(xi)^(t))N\left(B a+b, C_{\xi} B C_{\xi}^{t}\right).

1.5 Бесконечные семейства случайных величин и теорема Колмогорова

Пусть ( Omega,A,P\Omega, \mathcal{A}, P ) - вероятностное пространство, Z^(2)Z^{2} - двумерная целочисленная решетка, C subZ^(2)C \subset Z^{2} и xi_(C)=(xi_(c))_(c in C)\xi_{C}=\left(\xi_{c}\right)_{c \in C} - векторная ( |C||C|-мерная) случайная величина. Ее значениями являются, очевидно, наборы x_(C)x_{C} из множества

Y^(C)={x_(C)=(x_(c))_(c in C):x_(c)in Y,quad c in C}.Y^{C}=\left\{x_{C}=\left(x_{c}\right)_{c \in C}: x_{c} \in Y, \quad c \in C\right\} .

Для каждого x_(C)=(x_(c))_(c in C)x_{C}=\left(x_{c}\right)_{c \in C} из Y^(C)Y^{C} его вероятность p_(Y)c(x_(C))p_{Y} c\left(x_{C}\right) определяется равенством

p_(Y)c(x_(C))=P(omega in Omega:xi_(C)(omega)=x_(C)).p_{Y} c\left(x_{C}\right)=P\left(\omega \in \Omega: \xi_{C}(\omega)=x_{C}\right) .

Из определения дискретной случайной величины следует, что

Распределение вероятностей P_(Y)C=(p_(Y)c(x_(C)))_(x_(C)in Y)P_{Y} C=\left(p_{Y} c\left(x_{C}\right)\right)_{x_{C} \in Y} с векторной случайной величины xi_(C)\xi_{C} принято называть конечномерным распределением.

Пусть AA - подмножество CC, а B=C\\AB=C \backslash A. Тогда xi_(A)=(xi_(a))_(a in A)\xi_{A}=\left(\xi_{a}\right)_{a \in A} и xi_(B)=(xi_(b))_(b in B)\xi_{B}= \left(\xi_{b}\right)_{b \in B} - также векторные случайные величины со значениями в Y^(A)Y^{A} и Y^(B)Y^{B} и распределениями P_(Y^(A))=(p_(Y^(A))(x_(A)))_(x_(A)inY^(A))P_{Y^{A}}=\left(p_{Y^{A}}\left(x_{A}\right)\right)_{x_{A} \in Y^{A}} и P_(Y^(B))=(p_(Y^(B))(x_(B)))_(x_(B)inY^(B))P_{Y^{B}}=\left(p_{Y^{B}}\left(x_{B}\right)\right)_{x_{B} \in Y^{B}}. Так как C=A+B,x_(C)=(x_(A),x_(B))C= A+B, x_{C}=\left(x_{A}, x_{B}\right), то имеет место равенство

Пусть каждому конечному подмножеству CC из Z^(2)Z^{2} поставлено в соответствие распределение вероятностей P_(Y)c=(p_(Y)c(x_(C)))_(x_(C)in Y)P_{Y} c=\left(p_{Y} c\left(x_{C}\right)\right)_{x_{C} \in Y}. Конечномерные распределения, образующие семейство называются согласованными, если для них выполняется указанное выше равенство.

Семейство (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}} дискретных случайных величин, определенных на (Omega,A)(\Omega, \mathcal{A}), со значениями в конечном множестве YY называется случайным полем на Z^(2)Z^{2}. В 1933 году вышла книга А.Н. Колмогорова с названием «Основные понятия теории вероятностей». В ней доказана теорема, в которой утверждается, что перечисленные выше условия являются не только необходимыми, но и достаточными для существования случайного поля. Применительно к рассматриваемому случаю ее формулировка выглядит следующим образом.

(1.5.1) Пусть YY - конечное подмножество из RR, и пусть каждому конечному подмножеству A subZ^(2)A \subset Z^{2} поставлено в соответствие конечномерное распределение вероятностей P_(Y^(A))=(p_(Y^(A))(x_(A)))_(x_(A)inY^(A))P_{Y^{A}}=\left(p_{Y^{A}}\left(x_{A}\right)\right)_{x_{A} \in Y^{A}} на Y^(A)Y^{A}. Если эти распределения

являются согласованными, то существует случайное поле (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}} такое, что для любого x_(A)=(x_(a))_(a in A)x_{A}=\left(x_{a}\right)_{a \in A} выполняется равенство

P(omega in Omega:xi_(A)(omega)=x_(A))=p_(Y^(A))(x_(A)).P\left(\omega \in \Omega: \xi_{A}(\omega)=x_{A}\right)=p_{Y^{A}}\left(x_{A}\right) .

Доказательство теоремы Колмогорова можно найти в работах [XXX]. В следующем подразделе предлагается пример ее применения.

При любом фиксированном omega in Omega\omega \in \Omega каждая случайная величина xi_(z),z inZ^(2)\xi_{z}, z \in Z^{2}, принимает некоторое значение x_(z)=xi_(z)(omega)x_{z}=\xi_{z}(\omega) из YY. Таким образом, каждое omega in Omega\omega \in \Omega определяет семейство x=(x_(z))_(z inZ^(2))x=\left(x_{z}\right)_{z \in Z^{2}}. Оно называется реализацией или выборочной поверхностью случайного поля.

1.6 Примеры случайных полей

Очевидно, что распределение P_(Y^(A))=(p_(Y^(A))(x_(A)))_(x_(A)inY^(A))P_{Y^{A}}=\left(p_{Y^{A}}\left(x_{A}\right)\right)_{x_{A} \in Y^{A}} на Y^(A)Y^{A} состоит из |Y|^(|A|)|Y|^{|A|} вероятностей. При решении прикладных задач априорные сведения о свойствах сцены, необходимые для определения вероятностей, образующих распределение P_(Y)^(A)P_{Y}{ }^{A}, часто отсутствуют. В этих условиях приходится идти на различные ограничения. Одним из таких ограничений может быть предположение о независимости случайных величин, образующих поле (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}}. Оно позволяет представить вероятность p_(Y^(A))(x_(A))p_{Y^{A}}\left(x_{A}\right) в виде произведения из |A||A| вероятностей p_(Y){a}(x_(a)),a in Ap_{Y}\{a\}\left(x_{a}\right), a \in A :

p_(Y^(A))(x_(A))=prod_(a in A)p_(Y^({a}))(x_(a)).p_{Y^{A}}\left(x_{A}\right)=\prod_{a \in A} p_{Y^{\{a\}}}\left(x_{a}\right) .

Очевидно, что для задания распределения P_(Y^({a}))=(p_(Y^({a}))(y))_(y in Y)P_{Y^{\{a\}}}=\left(p_{Y^{\{a\}}}(y)\right)_{y \in Y} случайной величины xi_(a),a in A\xi_{a}, a \in A, требуется всего |Y||Y| вероятностей. Поэтому для задания распределения P_(Y^(A))=(p_(Y^(A))(x_(A)))_(x_(A)inY^(A))P_{Y^{A}}=\left(p_{Y^{A}}\left(x_{A}\right)\right)_{x_{A} \in Y^{A}} на множестве Y^(A)Y^{A} требуется |A||Y||A||Y| вероятностей вида p_(Y^({a}))(x_(a))p_{Y^{\{a\}}}\left(x_{a}\right) вместо |Y|^(|A|)|Y|^{|A|} вероятностей p_(Y^(A))(x_(A))p_{Y^{A}}\left(x_{A}\right).

Осталось только убедиться в том, что определенный выше набор неотрицательных чисел p_(Y^(A))(x_(A))p_{Y^{A}}\left(x_{A}\right) на самом деле является конечномерным распределением на Y^(A)Y^{A} и для семейства всех таких распределений выполняются условия согласованности. Покажем вначале, что

{:[sum_(x_(A)inY^(A))(prod_(a in A)p_(Y^({a}))(x_(a)))=sum_(x_(b)in Y,b in A\\{a})sum_(x_(a)in Y)(p_(Y^({a}))(x_(a))prod_(b in A\\{a})p_(Y^({b}))(x_(b)))=],[sum_(x_(b)in Y,b in A\\{a})prod_(b in A\\{a})p_(Y^({b}))(x_(b))sum_(x_(a)in Y)p_(Y^({a}))(x_(a))=sum_(x_(b)in Y,b in A\\{a})prod_(b in A\\{a})p_(Y^({b}))(x_(b))]:}\begin{gathered}

\sum_{x_{A} \in Y^{A}}\left(\prod_{a \in A} p_{Y^{\{a\}}}\left(x_{a}\right)\right)=\sum_{x_{b} \in Y, b \in A \backslash\{a\}} \sum_{x_{a} \in Y}\left(p_{Y^{\{a\}}}\left(x_{a}\right) \prod_{b \in A \backslash\{a\}} p_{Y^{\{b\}}}\left(x_{b}\right)\right)= \\

\sum_{x_{b} \in Y, b \in A \backslash\{a\}} \prod_{b \in A \backslash\{a\}} p_{Y^{\{b\}}}\left(x_{b}\right) \sum_{x_{a} \in Y} p_{Y^{\{a\}}}\left(x_{a}\right)=\sum_{x_{b} \in Y, b \in A \backslash\{a\}} \prod_{b \in A \backslash\{a\}} p_{Y^{\{b\}}}\left(x_{b}\right)

\end{gathered}

Введя обозначение B=A\\{a}B=A \backslash\{a\}, приходим к сумме

sum_(x_(b)in Y,b in A\\{a})prod_(b in A\\{a})p_(Y^({b}))(x_(b))=sum_(x_(B)inY^(B))(prod_(b in B)p_(Y^({b}))(x_(b))),\sum_{x_{b} \in Y, b \in A \backslash\{a\}} \prod_{b \in A \backslash\{a\}} p_{Y^{\{b\}}}\left(x_{b}\right)=\sum_{x_{B} \in Y^{B}}\left(\prod_{b \in B} p_{Y^{\{b\}}}\left(x_{b}\right)\right),

в которой на одно слагаемое меньше, чем в первоначальной сумме. Результатом последовательного выполнения указанных операций ( |A|-1|A|-1 ) раз является равенство

означающее, что семейство P_(Y^(A))=(p_(Y^(A))(x_(A)))_(x_(A)inY^(A))P_{Y^{A}}=\left(p_{Y^{A}}\left(x_{A}\right)\right)_{x_{A} \in Y^{A}} действительно является распределением на Y^(A)Y^{A}.

Осталось показать, что распределения P_(Y^(A))=(p_(Y^(A))(x_(A)))_(x_(A)inY^(A))P_{Y^{A}}=\left(p_{Y^{A}}\left(x_{A}\right)\right)_{x_{A} \in Y^{A}}, сопоставленные всем конечным подмножествам из Z^(2)Z^{2}, являются согласованными. Пусть AA и BB - непересекающиеся подмножества Z^(2)Z^{2}. В этом случае

{:[sum_(x_(B)inY^(B))p_(Y^(A+B))(x_(A+B))=sum_(x_(B)inY^(B))(prod_(c in A+B)p_(Y^({c}))(x_(c)))=],[sum_(x_(B)inY^(B))(prod_(a in A)p_(Y^({a}))(x_(a))prod_(b in B)p_(Y^({b}))(x_(b)))=prod_(a in A)p_(Y^({a}))(x_(a))sum_(x_(B)inY^(B))(prod_(b in B)p_(Y^({b}))(x_(b)))=],[=p_(Y^(A))(x_(A))sum_(x_(B)inY^(B))p_(Y^(B))(x_(B))=p_(Y^(A))(x_(A))]:}\begin{gathered}

\sum_{x_{B} \in Y^{B}} p_{Y^{A+B}}\left(x_{A+B}\right)=\sum_{x_{B} \in Y^{B}}\left(\prod_{c \in A+B} p_{Y^{\{c\}}}\left(x_{c}\right)\right)= \\

\sum_{x_{B} \in Y^{B}}\left(\prod_{a \in A} p_{Y^{\{a\}}}\left(x_{a}\right) \prod_{b \in B} p_{Y^{\{b\}}}\left(x_{b}\right)\right)=\prod_{a \in A} p_{Y^{\{a\}}}\left(x_{a}\right) \sum_{x_{B} \in Y^{B}}\left(\prod_{b \in B} p_{Y^{\{b\}}}\left(x_{b}\right)\right)= \\

=p_{Y^{A}}\left(x_{A}\right) \sum_{x_{B} \in Y^{B}} p_{Y^{B}}\left(x_{B}\right)=p_{Y^{A}}\left(x_{A}\right)

\end{gathered}

Таким образом, построенное семейство конечномерных распределений является согласованным. По теореме Колмогорова существует случайное поле, для которого распределения, образующие семейство, будут конечномерными распределениями.

Следующим упрощением, вызванным теми же причинами, является предположение о том, что все случайные величины, образующие векторную случайную величину xi_(A)\xi_{A}, имеют одно и тоже распределение: p_(Y){a}(y)=p_(A)(y)p_{Y}\{a\}(y)=p_{A}(y) для любых a in Aa \in A и любых y in Yy \in Y. В этом случае для любого x_(A)=(x_(a))_(a in A)inY^(A)x_{A}=\left(x_{a}\right)_{a \in A} \in Y^{A} вероятность p_(Y^(A))(x_(A))p_{Y^{A}}\left(x_{A}\right) принимает вид

p_(Y^(A))(x_(A))=prod_(a in A)p_(Y^({a}))(x_(a))=prod_(a in A)p_(A)(x_(a)).p_{Y^{A}}\left(x_{A}\right)=\prod_{a \in A} p_{Y^{\{a\}}}\left(x_{a}\right)=\prod_{a \in A} p_{A}\left(x_{a}\right) .

Таким образом, последнее предположение позволяет обойтись для задания конечномерного распределения P_(Y^(A))=(p_(Y^(A))(x_(A)))_(x_(A)inY^(A))P_{Y^{A}}=\left(p_{Y^{A}}\left(x_{A}\right)\right)_{x_{A} \in Y^{A}} только |Y||Y| вероятностями распределения P_(A)=(p_(A)(y))_(y in Y)P_{A}=\left(p_{A}(y)\right)_{y \in Y}. Пример изображения случайного поля с такими свойствами приводится в конце подраздела.

Из определения построенного случайного поля следует, что образующие его случайные величины являются независимыми в совокупности и имеют одно и тоже распределение. Для случайных полей, используемых при решении прикладных задач, такое свойство является скорее исключением, а не правилом. Ниже предлагается способ построения случайного поля, между случайными величинами которого существует статистическая зависимость. Для его построения воспользуемся только что полученным результатом.

Пусть (zeta_(z))_(z inZ^(2))\left(\zeta_{z}\right)_{z \in Z^{2}} - случайное поле из независимых скалярных случай-

ных величин, имеющих одно и то же распределение со средним значением равным нулю и дисперсией sigma^(2)\sigma^{2}. Тогда

cov(zeta_(z),zeta_(t))=Ezeta_(z)zeta_(t)={[sigma^(2)","z=t],[0","z!=t]:}\operatorname{cov}\left(\zeta_{z}, \zeta_{t}\right)=E \zeta_{z} \zeta_{t}=\left\{\begin{array}{c}

\sigma^{2}, z=t \\

0, z \neq t

\end{array}\right.

Квадратной окрестностью точки z inZ^(2)z \in Z^{2} с радиусом hat(r)\hat{r} будем называть подмножество вида

состоящая из |B(z, hat(r))|=(2 hat(r)+1)^(2)|B(z, \hat{r})|=(2 \hat{r}+1)^{2} точек. Для каждого z inZ^(2)z \in Z^{2} определим случайную величину xi_(z)\xi_{z} равенством

По аналогии со случайными последовательностями (см., например [63, c. 83]) назовем семейство (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}} случайным полем, полученным из случайного поля (zeta_(z))_(z inZ^(2))\left(\zeta_{z}\right)_{z \in Z^{2}} скользящим суммированием по окрестности B(z, hat(r))B(z, \hat{r}).

Легко подсчитать, что для каждого z inZ^(2)z \in Z^{2} среднее значение Exi_(z)=0E \xi_{z}=0, дисперсия D(xi_(z))=sigma^(2)//(2 hat(r)+1)^(2)D\left(\xi_{z}\right)=\sigma^{2} /(2 \hat{r}+1)^{2}, а

{:[Exi_(z)xi_(z+t)=E((1)/(|B(z,( hat(r)))|)sum_(s in B(z, hat(r)))zeta_(s)(1)/(|B(z,( hat(r)))|)sum_(s in B(z+t, hat(r)))zeta_(s))=],[(1)/((2( hat(r))+1)^(4))(sum_(s in B(z, hat(r)))sum_(u in B(z+t, hat(r)))Ezeta_(s)zeta_(u))]:}\begin{aligned}

E \xi_{z} \xi_{z+t}= & E\left(\frac{1}{|B(z, \hat{r})|} \sum_{s \in B(z, \hat{r})} \zeta_{s} \frac{1}{|B(z, \hat{r})|} \sum_{s \in B(z+t, \hat{r})} \zeta_{s}\right)= \\

& \frac{1}{(2 \hat{r}+1)^{4}}\left(\sum_{s \in B(z, \hat{r})} \sum_{u \in B(z+t, \hat{r})} E \zeta_{s} \zeta_{u}\right)

\end{aligned}

Если окрестности B(z, hat(r))B(z, \hat{r}) и B(z+t, hat(r))B(z+t, \hat{r}) не пересекаются (|t| > 2 hat(r)sqrt2)(|t|>2 \hat{r} \sqrt{2}), то s!=us \neq u. В этом случае все слагаемые в двойной сумме равны нулю. Поэтому и Exi_(z)xi_(z+t)=0E \xi_{z} \xi_{z+t}=0. В противном случае, если окрестности B(z, hat(r))B(z, \hat{r}) и B(z+t, hat(r))B(z+t, \hat{r}) пересекаются (это может произойти, когда 0 <= |t| <= widehat(2)rsqrt20 \leq|t| \leq \widehat{2} r \sqrt{2} ), то среди всех (2 hat(r)+1)^(4)(2 \hat{r}+1)^{4} слагаемых двойной суммы присутствуют |B(z, hat(r))nn B(z+t, hat(r))||B(z, \hat{r}) \cap B(z+t, \hat{r})| слагаемых вида Ezeta_(z)zeta_(z)=sigma^(2)E \zeta_{z} \zeta_{z}=\sigma^{2}. В этом случае

Осталось показать, что ковариация не завит от сдвига, то есть Exi_(z)xi_(z+t)=Exi_(z+a)xi_(z+t+a)E \xi_{z} \xi_{z+t}=E \xi_{z+a} \xi_{z+t+a} при любом a inZ^(2)a \in Z^{2}. Так как

Пусть u in B(z+a, hat(r))nn B(z+t+a, hat(r))u \in B(z+a, \hat{r}) \cap B(z+t+a, \hat{r}), тогда должны выполняться при j=1,2j=1,2 неравенства |(z_(j)+t_(j)+a_(j))-u_(j)| <= hat(r)\left|\left(z_{j}+t_{j}+a_{j}\right)-u_{j}\right| \leq \hat{r} и |(z_(j)+a_(j))-u_(j)| <= hat(r)\left|\left(z_{j}+a_{j}\right)-u_{j}\right| \leq \hat{r}. Эти же неравенства после перегруппировки слагаемых |(z_(j)+t_(j))-(u_(j)+a_(j))| <= hat(r)\left|\left(z_{j}+t_{j}\right)-\left(u_{j}+a_{j}\right)\right| \leq \hat{r} и |(z_(j))-(u_(j)+a_(j))| <= hat(r)\left|\left(z_{j}\right)-\left(u_{j}+a_{j}\right)\right| \leq \hat{r} означают, что (u+a)in B(z, hat(r))nn B(z+t, hat(r))(u+a) \in B(z, \hat{r}) \cap B(z+t, \hat{r}). Тем самым доказано включение

называется ковариационной функцией случайного поля (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}}. Из доказанного выше следует, что для случайных полей, получаемых скользящим суммированием, выполняется равенство

Оно означает, что значение r(z,t)r(z, t) ковариационной функции зависит только от разности (z-t)(z-t). Случайные поля с такими ковариационными функциями и средними значениями, не зависящими от z inZ^(2)z \in Z^{2}, называются однородными в широком смысле. Их ковариационные функции являются отображениями вида r:Z^(2)rarr Rr: Z^{2} \rightarrow R. Поэтому значение r(t)r(t) ковариационной функции случайного поля, полученного скользящим суммирование, определя-

В таблицах 2.1 и 2.2 указаны ненулевые значения ковариационных

функций случайных полей, полученных скользящим суммированием с радиусами hat(r)=2\hat{r}=2 и hat(r)=1\hat{r}=1 соответственно. Нетрудно убедиться в том, что при hat(r)=1\hat{r}=1 ковариационная функция зависит только от расстояния |t-z||t-z| между случайными величинами xi_(t)\xi_{t} и xi_(z)\xi_{z}. Случайны поля с такими функциями называются однородными и изотропными.

Таблица 2.1 - Ковариационная функция ( hat(r)=2\hat{r}=2 )

Ниже приведены квадратные фрагменты со стороной 256 пикселей изображений трех случайных полей, полученные с помощью компьютера. Изображение с рисунка 1.5.1 соответствует случайному полю из независимых в совокупности случайных величин, имеющим нормальное распределение со средним значением m=128m=128 и СКО sigma=30\sigma=30. В таблице 2.3 приведены оценки значений нормированной ковариационной функции, вычисленные по этому изображению. Они хорошо согласуются с теоретическими значениями.

Таблица 2.3 - Оценка ковариационной функции ( hat(r)=0\hat{r}=0 )

На рисунках 1.5.2 и 1.5.3 приведены изображения случайных полей, полученных скользящим суммированием по окрестностям B(z, hat(r))B(z, \hat{r}) с радиусами hat(r)=1\hat{r}=1 и hat(r)=2\hat{r}=2 соответственно из случайного поля из независимых в совокупности случайных величин. Оценки средних значений, вычисленные по изображениям этих полей, совпали со средним значением исходного случайного поля. Оценки СКО равны 10 и 6 уровням, что совпало с теоретическими значениями. В таблицах 2.4 и 2.5 приведены оценки значений нормированных ковариационных функций, вычисленные по соответствующим изображениям...

Рисунок 1.5.1 - Изображение случайного поля с попарно независимыми случайными величинами

Рисунок 1.5.2 - Изображение случайного поля, полученного скользящим

Ковариационная функция. Характеристическое свойство ковариационной функции. Определение однородного случайного поля и свойства его ковариационной функции.

Если задано случайное поле (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}}, то каждой паре zz и tt из Z^(2)Z^{2} можно поставить в соответствие ковариацию cov(xi_(z),xi_(t))=E(xi_(z)-Exi_(z))(xi_(t)-Exi_(t))\operatorname{cov}\left(\xi_{z}, \xi_{t}\right)=E\left(\xi_{z}-E \xi_{z}\right)\left(\xi_{t}-E \xi_{t}\right) случайных величин xi_(z)\xi_{z} и xi_(t)\xi_{t}. Отображение r:Z^(2)rarr Rr: Z^{2} \rightarrow R, определяемое равенством r(z,t)=cov(xi_(z),xi_(t))r(z, t)=\operatorname{cov}\left(\xi_{z}, \xi_{t}\right), называется ковариационной функцией случайного поля.

(1.7.1) Пусть nn - натуральное число, c_(j),1 <= j <= nc_{j}, 1 \leq j \leq n, - произвольные вещественные числа, среди которых не все нули, тогда имеет место неравенство

при любых вещественных c_(j),1 <= j <= nc_{j}, 1 \leq j \leq n, и любых z_(j),t_(i)z_{j}, t_{i} из Z^(2)Z^{2}, называются неотрицательно определенными. Из доказанной теоремы следует, что каждая ковариационная функция является таковой. Следующая теорема утверждает, что верно и обратное утверждение.

(1.7.2) Если ff - неотрицательно определенная на Z^(2)Z^{2} функция, то существует случайное поле (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}} со средним значением m_(z)=0,z inZ^(2)m_{z}=0, z \in Z^{2}, для которого ff является ковариационной функцией

Exi_(z)xi_(t)=f(xi_(z),xi_(t)),z inZ^(2),t inZ^(2).E \xi_{z} \xi_{t}=f\left(\xi_{z}, \xi_{t}\right), z \in Z^{2}, t \in Z^{2} .

С доказательством теоремы можно ознакомиться по работам [XX]. А здесь намечены его основные этапы. Ранее в 1.4 показано, что нормальное распределение nn-мерной случайной величины xi=(xi_(j))_(1 <= j <= n)\xi=\left(\xi_{j}\right)_{1 \leq j \leq n} однозначно определяется вектором средних значений m=(m_(j))_(1 <= j <= n),m_(j)=Exi_(j)m=\left(m_{j}\right)_{1 \leq j \leq n}, m_{j}=E \xi_{j} и ковариационной матрицей C=(c_(ij))_(1 <= i,j <= n),c_(ij)=cov(xi_(i),xi_(j))C=\left(c_{i j}\right)_{1 \leq i, j \leq n}, c_{i j}=\operatorname{cov}\left(\xi_{i}, \xi_{j}\right), которая является неотрицательно определенной. Пусть rr - неотрицательно определенная функция на Z^(2)Z^{2}. Каждому конечному подмножеству A subZ^(2)A \subset Z^{2} можно сопоставить, используя rr, неотрицательно определенную ковариационную матрицу r(z,t)=cov(xi_(z),xi_(t))r(z, t)=\operatorname{cov}\left(\xi_{z}, \xi_{t}\right), z,t in Az, t \in A. Она задает |A||\mathrm{A}| - мерное нормальное распределение векторной случайной величины (xi_(a))_(a in A)\left(\xi_{a}\right)_{a \in A}. Доказывается, что семейство таких распределений является согласованным. В соответствии с теоремой Колмогорова оно задает на Z^(2)Z^{2} случайное поле, ковариационной функцией которого является rr.

Случайная величина считается заданной, если известно ее распределение вероятностей. Однако важная информация о случайной величине содержится в ее числовых характеристиках, главными из которых являются среднее значение и дисперсия. Если для решения поставленной задачи достаточно только этой информации, то можно использовать любую случайную величину с заданными средним значением и дисперсией. При этом следует помнить, что для задания случайной величины этих сведений недостаточно. Оказывается, что похожим образом обстоят дела и в случае случайных полей. При решении широкого класса прикладных задач оказывается достаточно знать только среднее значение (m_(z))_(z inZ^(2))\left(m_{z}\right)_{z \in Z^{2}} и ковариационную функцию rr случайного поля. Поэтому для его задания вместо семейства согласованных конечномерных распределений, можно использовать неотрицательно определенную функцию с нужными свойствами. Теорема (1.7.2) утверждает, что всегда существует случайное поле, для которого она является ковариационной функцией.

Довольно часто предполагается, что свойства случайного поля, описываемые средним значением и ковариационной функцией, должны оставаться неизменными для различных z inZ^(2)z \in Z^{2}. Формально это приводит к требованиям о том, что среднее значение m_(z)m_{z} поля должно быть константой: m_(z)=m,z inZ^(2)m_{z}=m, z \in Z^{2}, а значение ковариационной функции не должно изменяться при сдвиге на произвольный вектор a inZ^(2)a \in Z^{2}

Случайные поля, удовлетворяющие этому предположению, называются однородными случайными полями в широком смысле. Поскольку далее будут рассматриваться только такие случайные поля, то слова «в широком смысле» будут, как правило, опускаться. Так как значение r(xi_(z),xi_(t))r\left(\xi_{z}, \xi_{t}\right) ковариационной функции однородного случайного поля зависит только от разности z-tz-t, то далее ковариация случайных величин xi_(z)\xi_{z} и xi_(t)\xi_{t} однородного случайного поля будет обозначаться cov(xi_(z+t),xi_(z))=r(t)\operatorname{cov}\left(\xi_{z+t}, \xi_{z}\right)=r(t).

Сделанные предположения позволяют установить следующие свойства ковариационной функции однородного случайного поля

Строгое неравенство r(0) > 0r(0)>0 имеет место только в том случае, когда xi_(z)\xi_{z} не является константой. Второе свойство следует также из определения

Для доказательства третьего свойства воспользуемся неравенством |E xi eta| <= E|xi eta||E \xi \eta| \leq E|\xi \eta| и неравенством Буняковского-Коши-Шварца E|xi eta| <= sqrt(E(xi)^(2)E(eta)^(2))E|\xi \eta| \leq \sqrt{E(\xi)^{2} E(\eta)^{2}}, доказательство которого приводится в 1.2.

Довольно часто при решении прикладных задач доступная информация об однородном случайном поле представлена набором его выборочных поверхностей. Ниже формулируется теорема, принадлежащая Слуцкому Е. Е. Она определяет условия, при выполнении которых среднее арифметическое значение, вычисленное по ограниченному фрагменту единственной выборочной поверхности, может использоваться в качестве оценки неизвестного среднего значения. Теорема была доказана Слуцким для стационарных в широком смысле случайных процессов. Предлагаемая ниже теорема (1.7.1) является ее естественным обобщением для случая, когда семейство случайных величин является однородным случайным полем.

Последовательность (xi_(n))_(n >= 1)\left(\xi_{n}\right)_{n \geq 1} случайных величин называется сходящейся к случайной величине xi\xi в среднеквадратическом, если числовая последовательность E(xi_(n)-xi)^(2)E\left(\xi_{n}-\xi\right)^{2} из средних значений сходится к нулю:

Далее такая сходимость будет обозначаться xi_(n)rarr xi\xi_{n} \rightarrow \xi в ср. кв.

Последовательность (xi_(n))_(n >= 1)\left(\xi_{n}\right)_{n \geq 1} случайных величин называется сходящейся к случайной величине xi\xi по вероятности, если для любого epsi > 0\varepsilon>0 числовая последовательность P(|xi_(n)-xi| <= epsi)P\left(\left|\xi_{n}-\xi\right| \leq \varepsilon\right) сходится к нулю

Такая сходимость (xi_(n))_(n >= 1)\left(\xi_{n}\right)_{n \geq 1} к xi\xi будет обозначаться xi_(n)rarr"P"xi\xi_{n} \xrightarrow{P} \xi.

Легко показать, что из сходимости xi_(n)rarr xi\xi_{n} \rightarrow \xi в ср. кв. следует сходимость xi_(n)rarr"P"xi\xi_{n} \xrightarrow{P} \xi по вероятности. В самом деле, применяя неравенство Чебышева к разности xi_(n)-xi\xi_{n}-\xi, получаем для любого epsi > 0\varepsilon>0 неравенство

Из сходимости xi_(n)rarr xi\xi_{n} \rightarrow \xi в ср. кв. следует, что lim_(n rarr+oo)E(xi_(n)-xi)^(2)=0\lim _{n \rightarrow+\infty} E\left(\xi_{n}-\xi\right)^{2}=0. Поэтому для любых delta > 0\delta>0 и epsi > 0\varepsilon>0 существует такое n(delta,epsi)n(\delta, \varepsilon), что E(xi_(n)-xi)^(2) < deltaepsi^(2)E\left(\xi_{n}-\xi\right)^{2}<\delta \varepsilon^{2} при n > n(delta,epsi),an> n(\delta, \varepsilon), \mathrm{a}

Это означает, что (xi_(n))_(n >= 1)\left(\xi_{n}\right)_{n \geq 1} сходится к xi\xi по вероятности. Отметим, что обратное утверждение неверно: из сходимости по вероятности не следует сходимость в ср. кв.

После замены события |xi_(n)-xi| > epsi\left|\xi_{n}-\xi\right|>\varepsilon из левой части последнего неравенства на противоположное |xi_(n)-xi| <= epsi\left|\xi_{n}-\xi\right| \leq \varepsilon следует неравенство

которое выполняется при любых n > n(delta,epsi)n>n(\delta, \varepsilon). Поэтому, если omega in Omega,x=xi(omega)\omega \in \Omega, x=\xi(\omega) и x_(n)=xi_(n)(omega)x_{n}=\xi_{n}(\omega) для всех n >= 1n \geq 1, то из него (неравенства) следует, что

Это неравенство допускает важную частотную интерпретацию. Оно означает, что при n > n(delta,epsi)n>n(\delta, \varepsilon) относительная частота события |x-x_(n)| <= epsi\left|x-x_{n}\right| \leq \varepsilon будет не меньше, чем 1-delta1-\delta. Однако, это не означает, что равенство lim_(n rarr+oo)x_(n)=x\lim _{n \rightarrow+\infty} x_{n}=x выполняется для всех omega in Omega\omega \in \Omega.

(1.7.1) Пусть (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}} - однородное случайное поле со средним значением mm и ковариационной функцией r,A_(n)subZ^(2)r, A_{n} \subset Z^{2} - квадрат со стороной nn и x_(A_(n))x_{A_{n}} - изображение. Для того, чтобы последовательность m_(n)m_{n} случайных величин, определяемая равенством

По предположению m_(n)rarr mm_{n} \rightarrow m в ср. кв. при n rarr+oon \rightarrow+\infty. Поэтому для любого epsi > 0\varepsilon>0 существует n(epsi)n(\varepsilon) такой, что для всех n > n(epsi)n>n(\varepsilon) выполняется неравенство

Следствие. Если r(a)rarr0r(a) \rightarrow 0 при |a|=(a_(1)^(2)+a_(2)^(2))^((1)/(2))rarr+oo|a|=\left(a_{1}^{2}+a_{2}^{2}\right)^{\frac{1}{2}} \rightarrow+\infty, то

сходится в среднем квадратичном к mm при n rarr+oon \rightarrow+\infty.

Доказательство. Так как r(a)rarr0r(a) \rightarrow 0 при |a|rarr+oo|a| \rightarrow+\infty, то, для любого epsi > 0\varepsilon>0 существует такое a_(epsi)a_{\varepsilon}, что |r(a)| < epsi|r(a)|<\varepsilon при всех |a| > |a_(epsi)||a|>\left|a_{\varepsilon}\right|. Пусть

A_(n)(epsi)={a inA_(n):|a| > |a_(epsi)|}" и "M=max_(inA_(n)\\A_(n)(epsi))|r(a)|A_{n}(\varepsilon)=\left\{a \in A_{n}:|a|>\left|a_{\varepsilon}\right|\right\} \text { и } M=\max _{\in A_{n} \backslash A_{n}(\varepsilon)}|r(a)|и

Определение статистической гипотезы. Примеры гипотез. Назначение выборки. Статистические критерии. Статистика для проверки гипотеза о виде распределения. Уровень значимости и критическая область.

Статистической гипотезой называется предположение о наличии у случайной величины или у нескольких случайных величин определенного свойства. Довольно часто проверяются гипотезы о виде распределения случайной величины, равенстве распределений двух и более случайных величин, об их независимости, а также гипотезы о свойствах числовых характеристик случайных величин. Для принятия гипотезы или отказа от нее используется информация о случайных величинах, содержащаяся в их выборках. Если выдвинутая гипотеза согласуется с информацией, содержащейся в выборках, то она принимается. В противном случае она отклоняется. Правило, в соответствии с которым гипотеза принимается или отвергается называется статистическим критерием. Одним из наиболее популярных статистических критериев является критерий, предложенный К. Пирсоном и получивший название chi^(2)\chi^{2} (хи квадрат). Ниже рассматривается пример его применения для проверки гипотезы о виде распределения случайной величины xi\xi. На основании исследования ее выборки (x_(j))_(1 <= j <= n)\left(x_{j}\right)_{1 \leq j \leq n} требуется подтвердить или отклонить предположение о том, что распределение случайной величины xi\xi является равномерным на интервале [a,b][\mathrm{a}, \mathrm{b}].

Проверка гипотезы начинается с разбиения интервала [a,b][a, b] точками (a_(j))_(1 <= j <= N+1),a=a_(1) < cdots < a_(N+1)=b\left(a_{j}\right)_{1 \leq j \leq N+1}, a=a_{1}<\cdots<a_{N+1}=b, на NN непересекающихся подинтервалов [a_(j),a_(j+1)[,1 <= j < N:}\left[a_{j}, a_{j+1}\left[, 1 \leq j<N\right.\right., и [a_(N),a_(N+1)]\left[a_{N}, a_{N+1}\right]. Затем для каждого подинтервала с левой границей a_(j)a_{j} определяется число n_(j)n_{j} элементов выборки, оказавшихся в нем. Очевидно, что должно выполняться равенство n_(1)+cdots+n_(N)=nn_{1}+\cdots+n_{N}=n. На следующем шаге для каждого подинтервала вычисляется вероятность p_(j),1 <= j <= Np_{j}, 1 \leq j \leq N, с которой случайная величина xi\xi принимает значение из [a_(j),a_(j+1)[:}\left[a_{j}, a_{j+1}[\right.. В соответствии с выдвинутой гипотезой ее распределение является равномерным на интервале [a,b][a, b]. Поэтому

p_(j)=P(a_(j) <= xi < a_(j+1))=(a_(j+1)-a_(j))/(b-a),1 <= j <= N.p_{j}=P\left(a_{j} \leq \xi<a_{j+1}\right)=\frac{a_{j+1}-a_{j}}{b-a}, 1 \leq j \leq N .

которая называется статистикой критерия. Она является случайной величиной. Доказано, что при верной гипотезе ее распределение стремится к распределению chi_(N-1)^(2)\chi_{N-1}^{2} с (N-1)(N-1) степенью свободы при n rarr+oon \rightarrow+\infty. Пусть alpha-\alpha- неотрицательное число, называемое уровнем значимости. Решая уравнение P(chi_(N-1)^(2) >= t_(alpha))=alphaP\left(\chi_{N-1}^{2} \geq t_{\alpha}\right)= \alpha, определяют неотрицательное число t_(alpha)t_{\alpha}. При значениях alpha\alpha близких к нулю (обычно alpha=0.001,0.01\alpha=0.001,0.01 или 0.05 ) событие chi_(N-1)^(2) >= t_(alpha)\chi_{N-1}^{2} \geq t_{\alpha} нас наблюдается редко. Поэтому интервал [t_(alpha),+oo[:}\left[t_{\alpha},+\infty[\right. часто называют критической областью. В соответствии с критерием хи квадрат для принятия гипотезы или ее отклонения требуется, используя выборку (x_(j))_(1 <= j <= n)\left(x_{j}\right)_{1 \leq j \leq n}, вычислить значение статистики X_(N-1)^(2)X_{N-1}^{2} и сравнить его с t_(alpha)t_{\alpha}. При наступлении события X_(N-1)^(2) < t_(alpha)X_{N-1}^{2}<t_{\alpha}, имеющую высокую вероятность ( 1-alpha1-\alpha ), гипотеза принимается. В противном случае, если произошло событие X_(N-1)^(2) >= t_(alpha)X_{N-1}^{2} \geq t_{\alpha} с низкой вероятностью alpha\alpha, гипотеза отклоняется.

Критерий хи квадрат следует применять в тех случаях, когда n >= 50n \geq 50, а n_(j) >= 5,1 <= j <= Nn_{j} \geq 5,1 \leq j \leq N. Для решения уравнения P(chi_(N-1)^(2) >= t_(alpha))=alphaP\left(\chi_{N-1}^{2} \geq t_{\alpha}\right)=\alpha использую таблицы распределения хи квадрат. Если число степеней свободы (N-1) > 30(N-1)>30, то вместо распределения хи квадрат используется нормальное. Его среднее значение и дисперсия оцениваются по выборке.

Изложенные выше сведения будут применяться в Главе 4 для выявления значимых локальных максимумов гистограммы амплитуд.

2.1 Определение локально однородной сцены

Определение объектов. Внутренние и граничные точки проекций. Изображения сцены и объекта. Свойства случайных величин, принадлежащих разным объектам. Определение простого объекта. Отличие сложного объекта от простого. Отличия их гистограмм.

Информация о сцене, как правило, носит не детерминированный, а статистический характер. Поэтому при создании модели сцены естественно воспользоваться теоретико-вероятностным подходом. Далее считается, что сцена является счетным множеством элементов, называемых пикселями. Каждый пиксель включает пару целых чисел z=(z_(1),z_(1))inZ^(2)z=\left(z_{1}, z_{1}\right) \in Z^{2}, которые называются его координатами, и дискретную случайную величину xi_(z)\xi_{z}. Все случайные величины (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}} определены на одном и том же вероятностном пространстве (Omega,A,P)(\Omega, \mathcal{A}, P) и принимают значения из конечного множества Y={0,1,dots,|Y|-1}Y=\{0,1, \ldots,|Y|- 1\}. Таким образом, сцена является случайным полем. Пусть omega\omega - некоторое элементарное событие из Omega\Omega, а x_(z)=xi_(z)(omega)x_{z}=\xi_{z}(\omega) - значение случайной величины в z inZ^(2)z \in Z^{2}. Изображением сцены будет называться семейство x=(x_(z))_(z inZ^(2))x=\left(x_{z}\right)_{z \in Z^{2}}. Одним из примеров получения изображения сцены является регистрация отраженного или собственного электромагнитного излучения сцены в оптическом диапазоне с помощью оптико-электронной системы.

Пусть dd - евклидово расстояние на Z^(2)Z^{2}. Точки zz и tt из Z^(2)Z^{2} назовем соседями, если расстояние между ними равно единице: d(z,t)=1d(z, t)=1. Таким образом, у каждой точки четыре соседа. Расстоянием между конечными подмножествами AA и BB из Z^(2)Z^{2} назовем число d(A,B)d(A, B), определяемое равенством

d(A,B)=min_(a in A,b in B)d(a,b).d(A, B)=\min _{a \in A, b \in B} d(a, b) .

Точка aa, принадлежащая подмножеству AA из Z^(2)Z^{2}, будет называться граничной точкой AA, если у нее существует сосед zz из Z^(2)\\AZ^{2} \backslash A (не принадлежащий

A). Подмножество граничных точек множества AA называется его границей и обозначается Fr_(A)\operatorname{Fr}_{A} или Fr(A)\operatorname{Fr}(A). Остальные точки подмножества AA будут называться внутренними. Все соседи внутренних точек принадлежат AA. На рисунке 2.1.1 изображены три подмножества A,BA, B и CC. Их элементами являются пересечения прямых перпендикулярных линий. Подмножество AA содержит пять

Рисунок 2.1.1 - Внутренние и граничные точки множества

точек. Одна из них внутренняя, а четыре точки, обозначенные ромбами - граничные. Подмножество BB состоит из 16 внутренних и 20 граничных точек. Все четыре точки подмножества CC являются граничными. Очевидно, что само множество Z^(2)Z^{2} состоит только из внутренних точек.

Подмножество BB из Z^(2)Z^{2} назовем связным, если для любой пары точек zz и tt из BB существует конечное семейство (a_(j))_(1 <= j <= n)\left(a_{j}\right)_{1 \leq j \leq n} точек из BB таких, что z=a_(1)z=a_{1}, t=a_(n)t=a_{n} и d(a_(j),a_(j+1))=1,1 <= j < nd\left(a_{j}, a_{j+1}\right)=1,1 \leq j<n. Подмножества, приведенные на рисунке 2.1.1, являются связными. Однако подмножество, являющееся суммой ( A+BA+ B ), таковым не является. Подмножество AA будет называться односвязным, если его дополнение A^(C)=Z^(2)\\AA^{C}=Z^{2} \backslash A является связным.

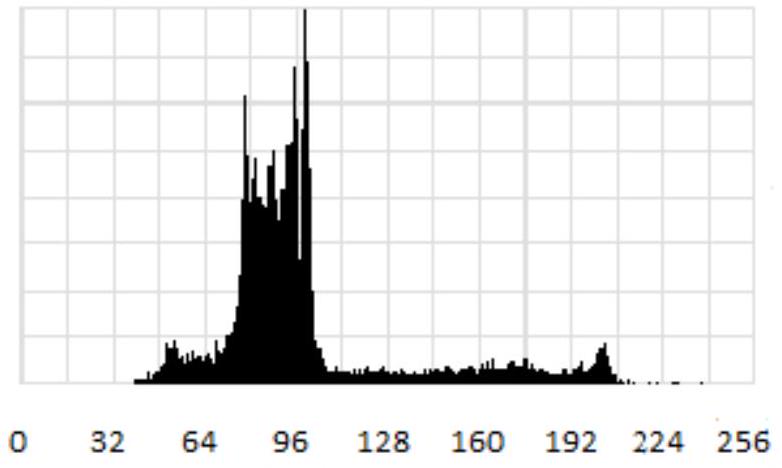

Пусть AA - конечное односвязное подмножество Z^(2)Z^{2}. Семейство из |A||A| случайных величин xi_(A)=(xi_(a))_(a in A)\xi_{A}=\left(\xi_{a}\right)_{a \in A} будет называться простым объектом с проекцией AA, если оно является фрагментом некоторого однородного случайного поля со средним значением m_(A)m_{A} и ковариационной функцией r_(A)r_{A}. Поэтому среднее значение амплитуды и ее дисперсия у всех пикселей простого объекта одни и те же. Изображением простого объекта будет называться семейство x_(A)=(x_(z))_(z in A),x_(z)in Yx_{A}=\left(x_{z}\right)_{z \in A}, x_{z} \in Y. Примером изображения простого объекта можно считать изображение вертолета, представленное на рисунке 2.1.2. Характерным признаком простого объекта является его гистограмма с ярко выраженным единственным локальным максимумом, приведенная на рисунке 2.1.2.

Рисунок 2.1.2 - Простой объект

Рисунок 2.1.3 - Гистограмма простого объекта

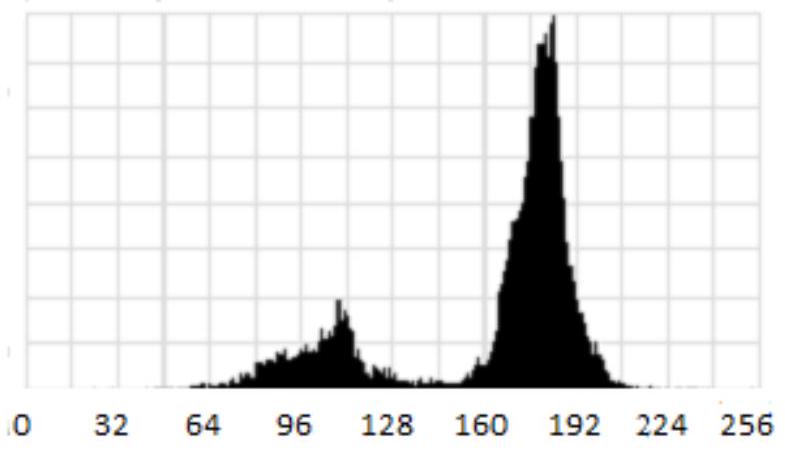

Довольно часто при решении прикладных задач приходится иметь дело с объектами xi_(B)\xi_{B}, односвязная проекция BB которых является объединением из nn непересекающихся связных подмножеств (B_(j))_(1 <= j <= n)\left(B_{j}\right)_{1 \leq j \leq n}. При этом каждое семейство (xi_(B_(j)))_(1 <= j <= n)\left(\xi_{B_{j}}\right)_{1 \leq j \leq n} случайных величин является простым объектом со своим средним значением m_(B_(j))m_{B_{j}} и своей ковариационной функцией r_(B_(j))r_{B_{j}}. Такие объекты xi_(B)\xi_{B} будут называться составными или сложными объектами и обозначаться xi_(B)=(xi_(B_(j)),1 <= j <= n)\xi_{B}= \left(\xi_{B_{j}}, 1 \leq j \leq n\right). Если простые объекты xi_(B_(i))\xi_{B_{i}} и xi_(B_(j))\xi_{B_{j}}, входящие в сложный объект xi_(B)\xi_{B}, оказались соседями: d(B_(i),B_(j))=1d\left(B_{i}, B_{j}\right)=1, то соответствующие им однородные случайные поля должны отличаться хотя бы одним из указанных числовых параметров. Изображением x_(B)x_{B} сложного объекта является объединение изображений x_(B_(j))x_{B_{j}}, составляющих его простых объектов: x_(B)=(x_(B_(j)),1 <= j <= n)x_{B}=\left(x_{B_{j}}, 1 \leq j \leq n\right). В качестве примера изображения сложного объекта можно привести изображение легкового автомобиля на рисунке 2.1.4. Характерным признаком сложного объекта является присутствие у гистограммы его изображения, представленной на рисунке 2.1.5, двух и более локальных максимумов.

Рисунок 2.1.4 - Сложный объект

Рисунок 2.1.5 - Гистограмма сложного объекта

В частном случае объект может состоять только из одного пикселя. Такие объекты называются одноточечными.

Объекты xi_(A)\xi_{A} и xi_(B)\xi_{B} будут называться соседями, если d(A,B)=1d(A, B)=1. Предполагается, что проекции разных объектов не пересекаются. Если xi_(A)\xi_{A} и xi_(B)-\xi_{B}- разные объекты, то для любых a in Aa \in A и b in Bb \in B случайные величины xi_(a)\xi_{a} и xi_(b)\xi_{b} считаются независимыми. Объединение проекций всех объектов равняется Z^(2)Z^{2}. В теореме существования (2.2.1) из 2.2 будет доказано, что для задания сцен с перечисленными выше свойствами достаточно определить распределения вероятностей P_(Y^(A))=(p_(Y^(A))(x_(A)))_(x_(A)inY^(A))P_{Y^{A}}=\left(p_{Y^{A}}\left(x_{A}\right)\right)_{x_{A} \in Y^{A}} только для ее объектов.

Сцена считается заданной, если известно разбиение Z^(2)Z^{2} на проекции образующих сцену простых объектов, а также если для каждого простого объекта с проекцией AA известно его среднее значение m_(A)m_{A} и ковариационная функция r_(A)r_{A}. Далее такие сцены будут называться локально однородными.

2.2 Теорема существования

Существование локально однородных сцен, сформулированное в предыдущем п. 2.2.1, доказывается в приводимой ниже теореме.

(2.2.1) Пусть на Z^(2)Z^{2} задано разбиение, состоящее из конечных попарно не пересекающихся подмножеств, называемых проекциями простых объектов, и пусть каждой проекции BB поставлено в соответствие распределение вероятностей P_(Y^(B))=(p_(Y^(B))(x_(B)))_(x_(B)inY^(B))P_{Y^{B}}=\left(p_{Y^{B}}\left(x_{B}\right)\right)_{x_{B} \in Y^{B}} на Y^(B)Y^{B}. Тогда существует вероятностное пространство ( Omega,A,P\Omega, \mathcal{A}, P ) и локально однородная сцена (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}} на Z^(2)Z^{2} такая, что

P{omega in Omega:xi_(B)(omega)=x_(B)}=p_(Y^(B))(x_(B))P\left\{\omega \in \Omega: \xi_{B}(\omega)=x_{B}\right\}=p_{Y^{B}}\left(x_{B}\right)

для любой проекции BB и для любого x_(B)inY^(B)x_{B} \in Y^{B}. Кроме того, если AA и BB - проекции разных объектов сцены, то при любых a in Aa \in A и b in Bb \in B случайные величины xi_(a)\xi_{a} и xi_(b)\xi_{b} независимы:

Доказательство. В соответствии с теоремой Колмогорова [57], для задания случайного поля на Z^(2)Z^{2} необходимо и достаточно построить на Z^(2)Z^{2} семейство согласованных конечномерных распределений. В случае локально однородных сцен это можно сделать следующим образом.

Пусть AA - конечное подмножество Z^(2),(B_(j))_(j inJ_(A))Z^{2},\left(B_{j}\right)_{j \in J_{A}} - проекции простых объектов, такие, что

A subsum_(j inJ_(A))B_(j)" и "A nnB_(j)!=O/,j inJ_(A).A \subset \sum_{j \in J_{A}} B_{j} \text { и } A \cap B_{j} \neq \varnothing, j \in J_{A} .и

Очевидно, что (A nnB_(j))subB_(j)\left(A \cap B_{j}\right) \subset B_{j}. Поставим в соответствие каждому подмножеству (A nnB_(j))\left(A \cap B_{j}\right) семейство P_(Y)P_{Y} AnB _(j)=(p_(Y):}_{j}=\left(p_{Y}\right. AnB {:_(j)(X_(A nnB_(j))))\left._{j}\left(X_{A \cap B_{j}}\right)\right) с помощью равенства

Определим семейство P_(Y^(A))=(p_(Y^(A))(x_(A)))_(x_(A)inY^(A))P_{Y^{A}}=\left(p_{Y^{A}}\left(x_{A}\right)\right)_{x_{A} \in Y^{A}} с помощью равенства

Для доказательства выполнения условий согласованности для семейства конечномерных распределений выберем множество CC на Z^(2)Z^{2}, не пересекающееся с AA. Для CC также существует, как и для AA, конечное семейство (B_(j))_(j inJ_(C))\left(B_{j}\right)_{j \in J_{C}} такое, что

Поэтому определим на Y^(C)Y^{C} распределение P_(Y^(C))=(p_(Y)c(x_(C)))_(x_(C)inY^(C))P_{Y^{C}}=\left(p_{Y} c\left(x_{C}\right)\right)_{x_{C} \in Y^{C}} указанным выше способом

Таким образом, если для каждого объекта xi_(B)\xi_{B} задано распределение вероятностей P_(Y^(B))=(p_(Y^(B))(x_(B)))_(x_(B)inY^(B))P_{Y^{B}}=\left(p_{Y^{B}}\left(x_{B}\right)\right)_{x_{B} \in Y^{B}}, то существует случайное поле (xi_(z))_(z inZ^(2))\left(\xi_{z}\right)_{z \in Z^{2}} такое, что

P{omega:(xi_(b)(omega),b in B)=x_(B)}=p_(Y^(B))(x_(B)).P\left\{\omega:\left(\xi_{b}(\omega), b \in B\right)=x_{B}\right\}=p_{Y^{B}}\left(x_{B}\right) .

Независимость случайных величин xi_(a)\xi_{a} и xi_(b)\xi_{b}, принадлежащих разным проекциям AA и BB, следует непосредственно из определения конечномерных распределений. Пусть D={a,b}D=\{a, b\}. Так как AA и BB проекции, то их пересечение является пустым множеством. Кроме того, D nn A={a},D nn B={b}D \cap A=\{a\}, D \cap B=\{b\} и D sub(A+B)D \subset (A+B). Поэтому

p_(Y^(D))(x_(D))=p_(Y^(D nn A))(x_(D nn A))p_(Y^(D nn B))(x_(D nn B))=p_(Y^({a}))(x_(a))p_(Y^({b}))(x_(b)).p_{Y^{D}}\left(x_{D}\right)=p_{Y^{D \cap A}}\left(x_{D \cap A}\right) p_{Y^{D \cap B}}\left(x_{D \cap B}\right)=p_{Y^{\{a\}}}\left(x_{a}\right) p_{Y^{\{b\}}}\left(x_{b}\right) .

Таким образом, теорема существования доказана. Из нее следует, что построение скалярной сцены, с формальной точки зрения, сводится к разбиению Z^(2)Z^{2} на конечные подмножества (проекции образующих ее простых объектов) и заданию для каждой проекции AA совместного распределения P_(Y)^(A)P_{Y}{ }^{A} на Y^(A)Y^{A}.

2.3 Примеры сцен и изображений

В настоящей работе будут использоваться три вида сцен и изображений. Сценами первого типа служат различные участки поверхности Земли. Их изображения формируются оптико-электронными системами (в том числе многоспектральными). Поэтому такие сцены и их изображения называются далее реальными. Очевидно, что предположения, использованные при построении любой математической модели, для реальных сцен в полном объеме не выполняются. Однако хорошая модель должна быть "снисходительной" к некоторым нарушениям предположений, которые использовались при ее построении. В противном случае применимость модели для решения прикладных задач, в частности прогнозирования, становится сомнительной. Реальные используются для оценки адекватности математических моделей.

В качестве примера фрагмента реальной сцены предлагается квадратный участок земной поверхности. Он порос травой, редким кустарником и отдельными деревьями. На нем присутствуют следы, оставленные колесными и гусеничными транспортными средствами. В центре участка присутствует массивный стальной объект длиной 6 и шириной 3 м. На рисунках 2.3.1-2.3.3 представлены три скалярных изображения описанного фрагмента размером 256 на 256 пикселей. Они получены оптико-электронной системой строчного типа с механическим сканированием, расположенной на летательном аппарате. Съемка проводилась в диапазоне [0.7;1.1][0.7 ; 1.1] мкм (рисунок 2.3.1), [3.0;5.0] мкм (рисунок 2.3.2) и [8.0;12.0] мкм (рисунок 2.3.3). По условиям съемки, длина стороны квадратного пикселя на местности должна равняться 0.3 м. На изображениях (в основном на третьем) заметны горизонтальные полосы. Эта особенность, называемая специалистами строчностью, характерна для изображений, формируемых первыми оптико-электронными системами строчного типа с механическим сканированием.

К сожалению, в ходе съемки с целью получения векторного (трехмер-